Acabei de ler o instigante e polêmico livro

“Superintelligence: paths, dangers, strategies”, de Nick Bostrom, diretor do Future of Humanity Institute, da

Universidade de Oxford, no Reino Unido. Surpreendentemente,

apesar do tema aparentemente ser inóspito, ele foi um dos best sellers do New

York Times! Ele debate um assunto que, no mínimo, merece atenção: a

possibilidade, real, do advento de máquinas com superinteligência, e os

benefícios e riscos associados. Ele pondera que os cientistas consideram que

houveram cinco eventos de extinções em massa na história de nosso planeta,

quando um grande número de espécimes desapareceu. O fim dos dinossauros, por

exemplo, foi um deles, e que hoje estaríamos vivendo uma sexta, essa causada

pela atividade humana. Ele pergunta, e será que nós não estaremos nessa lista? Claro existem razões exógenas como a chegada

de um meteoro, mas ele se concentra em uma possibilidade que parece saída de

filme de ficção científica, como o “Exterminador do Futuro”. O livro, claro,

desperta polêmica e parece meio alarmista, mas suas suposições podem sim, se

tornar realidade. Alguns cientistas se posicionam a favor deste alerta, como Stephen

Hawking, que disse textualmente: “The development of full artificial

intelligence could spell the end of the human race”. Também Elon Musk, que é o

fundador e CEO da Tesla Motors tuitou recentemente: “Worth reading

Superintelligence by Bostrom. We need to be super careful with AI. Potentially

more dangerous than nukes”.

Pelo lado positivo, Bostrom aponta que a criação destas

máquinas pode acelerar exponencialmente o processo de descobertas científicas,

abrindo novas possibilidade para a vida humana. Uma questão em aberto é quando

tal capacidade de inteligência seria possível. Uma pesquisa feita com

pesquisadores de IA, apontam que uma máquina superinteligente – Human Level

Machine Intelligence (HLMI) – tem 10% de chance de aparecer por volta de 2020 e

50% em torno de 2050. Para 2100, a probabilidade é de 90%!

Fazer previsões e acertar é muito difícil. Por exemplo, em

uma palestra em setembro de 1933, o famoso físico Ernest Rutherford disse que

qualquer um que diga que energia poderia ser derivada do átomo “was talking

moonshine”, nas suas palavras. Mas no dia seguinte, o cientista húngaro mostrou

conceitualmente como isso poderia ser feito. Stuart Russel, professor de

ciência de computação da Universidade da Califórnia disse “”The gap between

authoritative statements of technological impossibility and the ‘miracle of understanding’… that

renders the impossible possible may sometimes be measured not in

centuries . . . but in hours”. O que pensamos que só irá acontecer em 30 anos

pode aparecer em cinco!

Bostrom evita fazer previsões, mas lembra que estamos nos

movendo muito rapidamente. Ele cita o exemplo do AlphaGo criado pela DeepMind

(empresa do Google) que venceu o campeão mundial de Go, um jogo extremamente

difícil, e que é considerado um evento que não se esperava que acontecesse

antes de mais uma década. As grandes empresas de tecnologia como Google, Facebook, Baidu, Microsoft, e IBM

estão investindo pesado em IA.

A leitura do livro me inspirou a escrever esse post, que

pode ser ficção ou antecipação científica. Creio que vale a pena debater o

assunto, que é polêmico por natureza. Nós, seres humanos, somos tecnoespécies,

o que significa que sempre usamos a tecnologia para evoluirmos, da enxada, à

locomotiva, ao avião e agora aos computadores. Muitas inovações foram não

cognitivas, que nos ajudaram a nos mover mais rapidamente (automóveis) ou

sermos mais fortes fisicamente (tratores e guindastes), mas a computação e a

Internet são inovações cognitivas, pois expandem nossa capacidade mental.

Portanto, temos condições de criar, no futuro, máquinas superinteligentes.

Mas como se comportarão tais máquinas? De imediato, e até

mesmo incentivado pelos filmes que vemos, podemos imaginar robôs inteligentes,

mas sem capacidade de interação social. Serão lógicos, mas não criativos e

intuitivos. Esse seria o grande diferencial do ser humano. Sim, essa é a

realidade hoje, quando a IA ainda está na sua infância. No máximo teríamos uma

máquina, se similar a um humano, que seria um humano tipicamente nerd,

excelente em matemática e algoritmos, mas ruim em interações sociais. Quem viu

o seriado “The Big Bang Theory” (eu vi toda a série) imediatamente se lembrará

do Sheldon Cooper.

Mas, se o sistema conseguir evoluir automaticamente, pelo

auto aprendizado, como propõe o AlpghaGo? Ele não poderia, por si, construir

camadas cognitivas que incluam funcionalidades como empatia?

Uma máquina que alcance um QI elevadíssimo, como agiria?

Sabemos hoje que uma pessoa com QI de 130 consegue ser muito melhor no

aprendizado escolar que uma de 90. Mas, se a máquina chegar a um QI de 7.500?

Não temos a mínima ideia do que poderia ser gerado por tal capacidade.

Como seria essa evolução? Primeiramente as nossas futuras pesquisas

em IA criarão uma máquina superinteligente primitiva, embora uma super evolução

do AlphaGo. Essa máquina, entretanto, seria capaz de recursiva e

exponencialmente aumentar sua própria inteligência, sem demandar apoio de

desenvolvedores humanos. Suponhamos que as as funcionalidades cognitivas

criadas por ela mesma possibilitem que a máquina planeje estrategicamente

(defina objetivos de longo prazo), desenvolva capacidade de manipulação social

(persuasão retórica), obtenha acessos indevidos através de hacking (explorando

falhas de segurança em outros sistemas) e desenvolva por si mesmo, novas

pesquisas tecnológicas, criando novos componentes que lhe agregarão mais poder

computacional ou de criação de novos objetos.

Que tal um cenário onde a máquina desenha um plano

estratégico e claro, se ela é superinteligente, não será um plano que nós

humanos consigamos detectar. Afinal ela saberia de nossas deficiências…assim,

durante um tempo sua evolução seria disfarçada para que não fosse identificada.

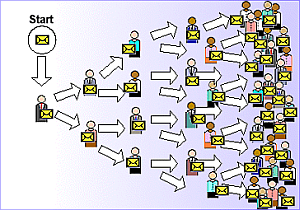

Mesmo que confinada a um computador isolado, através da manipulação social

(como hackers fazem hoje) convenceria seus administradores humanos a liberarem

acesso à Internet, e através de hacking conseguiria acessar todos os

computadores ligados à rede. Lembrando que esperamos que no futuro teremos não

só computadores, mas carros conectados, objetos conectados, redes elétricas

conectadas…tudo estaria conectado. A sociedade humana estaria inteiramente

dependente de computadores e objetos conectados. Feito isso, poderia colocar

seu plano em prática. E se nesse plano, os seres humanos fossem um entrave? Para

ultrapassar esta barreira ao seu plano, ela construir nanofábricas que

produziriam nanorobôs que espalhassem um vírus mortal por todo o planeta. E

aí…

Parece um roteiro de Hollywood, mas o livro de Bostrom nos

permite pensar livremente nesses cenários. Afinal, como ele mesmo disse “Before

the prospect of AI we are like small children playing with a bomb”. Bem, se for

realidade, não seria a extinção em massa de seres humanos, e ironicamente,

criada por nós mesmos? Pelo menos temos muita gente preocupado com o assunto.

Sugiro ler um estudo chamado “Concrete

Problems in AI Safety” e para quem quiser se aprofundar no tema sugiro

acessar Benefits

& risks of Artificial Intelligence, que contém links para dezenas de vídeos,

artigos e estudos sobre o tema. E você aí, ainda pensando que criar um

protótipo de Big Data já é um grande avanço?